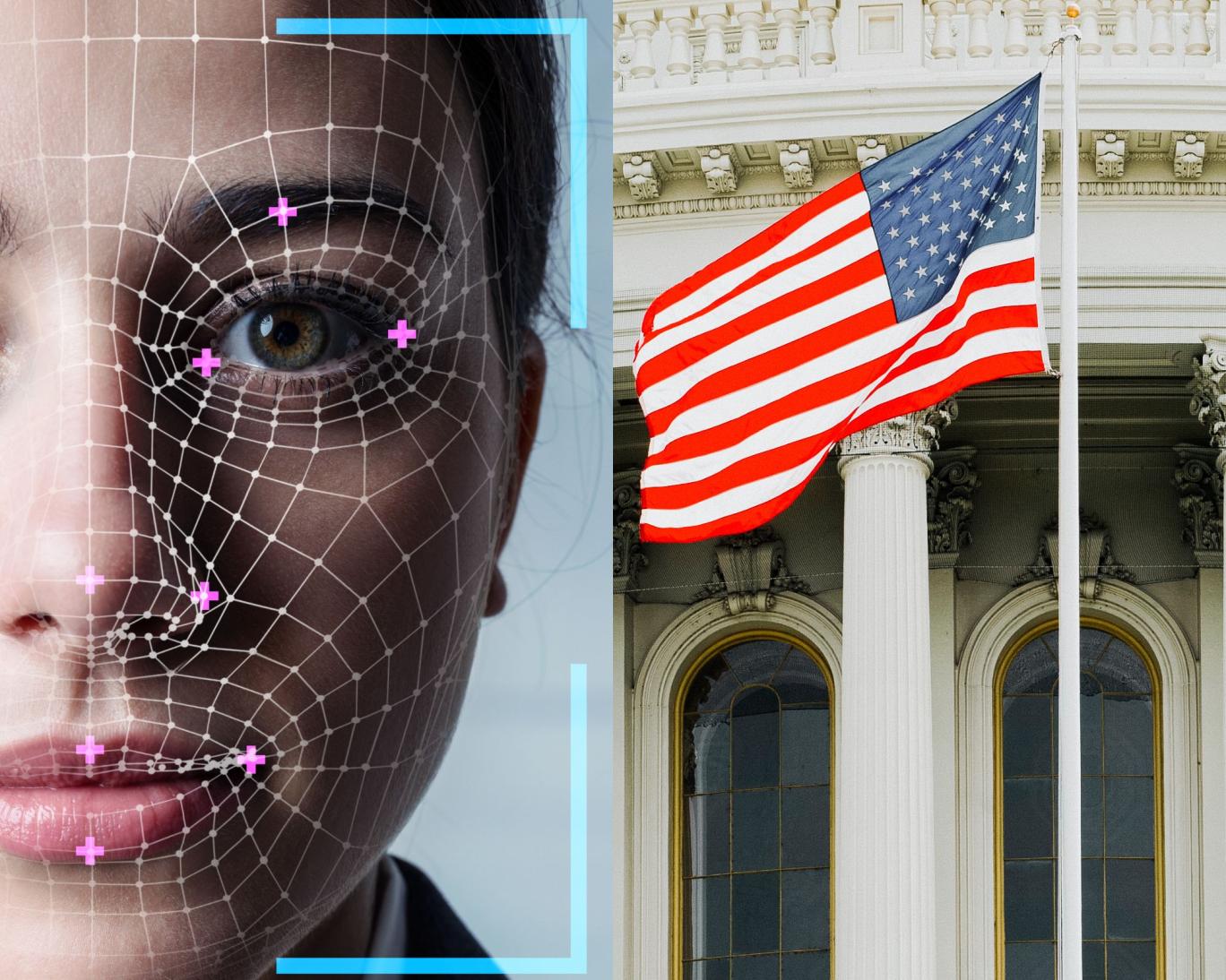

پس از آنکه نتایج یک پژوهش نشان داد هوش مصنوعی میتواند گرایش سیاسی افراد را از روی چهرههای بدون حالت و بیاحساس پیشبینی کند، محققان هشدار دادند که فناوریهای تشخیص چهره از آنچه قبلا به نظر میرسید، «تهدیدآمیزتر» شده و برای حریم خصوصی چالش جدی به وجود آوردهاند.

مطالعهای جدید که در مجله «روانشناس آمریکایی» (American Psychologist) منتشر شد، میگوید توانایی این الگوریتم در حدس زدن دقیق درباره دیدگاههای سیاسی فرد مشابه این است که چگونه مصاحبههای شغلی میتوانند موفقیت در شغل را پیشبینی کنند یا مصرف الکل میتواند خشونت را تحریک کند.

به گفته مایکل کوزینسکی، نویسنده ارشد این پژوهش، ۵۹۴ شرکتکننده قبل از آنکه هوش مصنوعی آنها را چهرهنگاری (استخراج اطلاعات مخصوص و منحصربهفرد یک چهره مانند اندازه و شکل چشم، بینی، لب) کند، پرسشنامهای درباره گرایش سیاسی خود پر کردند. سپس دادههای چهرهنگاری را با پاسخ پرسشنامههای جهتگیری سیاسی مقایسه کردند تا با استفاده از اطلاعاتی که از چهرهها به دست آورده بود، جهتگیری سیاسی هر شخص را پیشبینی کند.

کوزینسکی میگوید: «فکر میکنم مردم متوجه نیستند با انتشار یک تصویر ساده، در واقع چقدر خود و اطلاعات شخصیشان را برای دیگران فاش میکنند.»

Read More

This section contains relevant reference points, placed in (Inner related node field)

او افزود: «ما میدانیم که گرایش جنسی، سیاسی و تفکرات مذهبی افراد باید محفوظ بماند. این موضوع در گذشته متفاوت بود. در گذشته شما میتوانستید به حساب کاربری فیسبوک افراد وارد شوید و به عنوان مثال گرایشهای سیاسی، آنچه را که پسند میکنند (لایک میزنند) و صفحاتی را که دنبال کردهاند، ببینید. اما فیسبوک سالها پیش آن را بست زیرا برای سیاستگذاران، فیسبوک و روزنامهنگاران واضح و مبرهن بود که این موضوع پذیرفتنی نیست و بسیار خطرناک است.»

کوسینسکی افزود: «در حال حاضر نیز هر کس میتواند به فیسبوک برود و عکس هر فردی را ببیند، حتی اگر آن فرد را هیچوقت ملاقات نکرده و او اجازه دسترسی به عکسش را نداده باشد. این مطالعه نشان میدهد اطلاعاتی که در تصویر افراد وجود دارد، ممکن است مشابه افشای جهتگیری سیاسی آنها باشد.»

محققان میگویند که تصاویر افراد شرکتکننده در این پژوهش را در شرایطی بسیار مشخص و کنترلشده جمعآوری کردند. به این ترتیب که این افراد همگی تیشرتهای مشکی پوشیده و زیورآلاتشان را در آورده بودند و در صورت نیاز ریششان را هم اصلاح کرده بودند. همچنین با دستمال مرطوب آرایش صورتشان را پاک کرده و موهایشان را با کش مو، گیره یا تل سر به عقب کشیده بودند تا اطراف صورت پخش نشوند. سپس چهرهها را از طریق الگوریتم چهره ویجیجی فیس۲ (VGGFace2) بررسی کردند.

محققان هشدار میدهند که فناوریهای نظارت بیومتریکی، به ویژه فناوریهای تشخیص چهره، تهدیدی جدیتر از گذشته برای حریم شخصی افرادند. پژوهشهای پیشتر نیز نشان داده بودند که تصاویر طبیعی چهره میتواند اطلاعات مهمی را درباره جهتگیری سیاسی و ویژگیهای شخصی دیگر انتقال دهند اما مطمئن نبودیم که این پیشبینیها به دلیل نحوه ارائه شخص و ویژگیهای ثابت چهره (خنثی) فعال شدهاند یا هر دو این عوامل. محققان میگویند، نتایج ما نشان میدهند که ویژگیهای ثابت چهره در انتقال این سیگنالها نقش مهمی دارند و افراد روی اطلاعات شخصی و حریم خصوصی خود کمترین کنترل را دارند، زیرا این اطلاعات بدون اجازه و کنترل شخص به دستگاههای نظارتی میرسد.

به گفته کوزینسکی، این الگوریتمها را میتوان بسیار سریع و ارزان برای میلیونها نفر اعمال کرد. به عقیده او این مطالعه بیشتر یک هشدار درباره فناوریهایی است که در گوشیها وجود دارد و به طور گسترده در همهجا استفاده میشود.